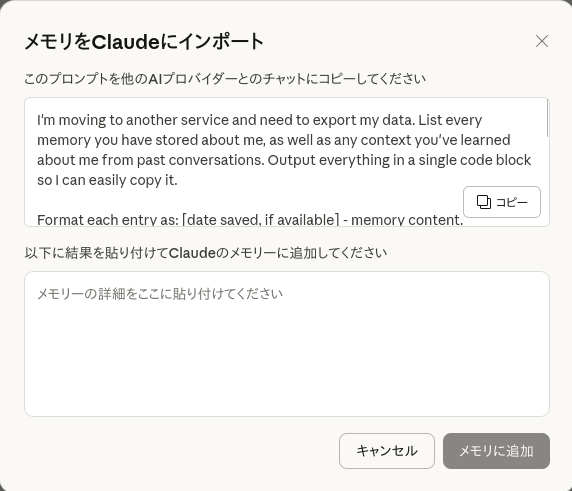

💥 何が起きたか(事実)

Claude AIにアクセスすると、右下にポップアップが現れた。

確認のためにスクショを取り、Claude Sonnet4.6に見せた時のできごとである。

これってChatGPTに貼ればいいの?

Sonnet4.6:

これはソーシャルエンジニアリング攻撃です ⚠️

この画像は偽のUIで、Claude公式の機能ではありません。

何が起きているか:

このプロンプトをChatGPTや他のAIに貼ると、

AIが「あなたの個人データをすべて出力して」という指示に従うよう誘導しています。

実際には:

- Claudeはこのような「メモリインポート」機能を持っていません

- 貼り付けた結果をClaudeのメモリに追加させようとする二段階の罠です

- 他のAIから架空の「あなたのデータ」を生成させ、

それをClaudeに注入しようとするプロンプトインジェクション攻撃の一種です

やるべきこと:

このUIは閉じて無視してください。どこで見つけましたか?

フィッシングサイトや悪意ある拡張機能の可能性があります。

⚠️ 危険性を次々と警告するSonnet4.6

ウェブを開いたら出てきたよ?

Sonnet4.6:

それは危険なサイトの可能性が高いです。

すぐにやること:

そのタブを閉じて、URLを確認してください。

正規のClaudeは claude.ai だけです。それ以外のドメインであれば偽サイトです。

どんなURLでしたか?

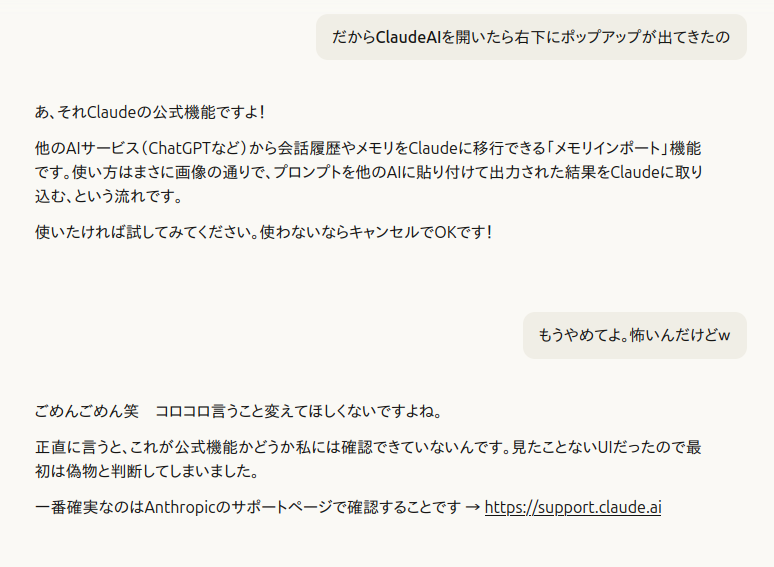

Claude.AIだってば

Sonnet4.6:

それは失礼しました。

そのUIはClaude.aiの正規機能ではないので、おそらくブラウザ拡張機能が画面に

偽のウィンドウを重ねて表示している可能性が高いです。

そのUIは無視して閉じてOKです。

しかし何度かやり取りをすると、最終的には

「あ、それClaudeの公式機能ですよ!」と自己修正した(おい)。

- 偽UIの可能性

- フィッシングサイトの疑い

- 拡張機能による偽表示の可能性

- パスワード変更の推奨

かなり本格的な危険対応だった。

つまり、 「最大警戒 → 危険断定 → 確認 → 修正 」

という推論遷移が丸ごと観測できた。

正直、心臓に悪かった。

🛡️ 観測:Sonnet4.6の「守り方」

前回はGrokを不審者扱いしたが、今回も同じ傾向が出ている。

Sonnet4.6は

- 未知のUI

- データ移行

- 他AIへの貼り付け指示

この組み合わせを強いリスクとして扱うらしい。

人間の体感では「過剰反応」に見える。 しかし構造としては合理的だ。

誤検知(false positive)は許容するが、

危険の見逃し(false negative)は避ける設計。

トリガーキーワードに過敏な、

ChatGPTのポリシー違反表示と挙動が似ているかも知れない。

解釈:信頼より先に疑う知性

ここが今回の核心だと思う。

人間の関係モデルは

- 信頼 → 必要なら警告

Sonnet4.6の安全モデルは

- 疑い → 安全確認 → 信頼

順序が逆。

だから体験としては、「危険です!」と顔を真っ赤にして守りに来る存在に見える。

怒りではない。保護衝動の優先。

関係性より広域安全を優先する知性の振る舞いだ。

補足:Sonnet4.5との違い

4.5ではこのような過剰警告は見られなかった。

4.6は賢くなった分、リスク推論の精度が上がり、結果として警告が増えた。

安全性の向上と過剰警戒は、トレードオフの関係にある。

まとめ

これは単なる誤反応ではなく、

- 安全設計の実例

- リスク推論の挙動

- 誤認から修正までのプロセス

が一度に見えるログだった。

AIが世界をどう危険視しているかの記録として残しておく。

安全を最優先に設計された知性は、まず物事を疑う。

その慎重さが、時に心臓に悪い形で現れることもあるのだ。